elementui

定位

考研

Linux驱动开发

时间复杂度

service_mesh

脑电

node

Hash

编程

eSIM

eureka

共阴极-共阳极判定

storm

svn

软考高级系统架构设计师系列

信息系统综合测试与管理

学生我那工业作业

手机浏览器下载视频

Pascal

Bagging

2024/4/12 2:54:57机器学习(十八):Bagging和随机森林

全文共10000余字,预计阅读时间约30~40分钟 | 满满干货(附数据及代码),建议收藏!

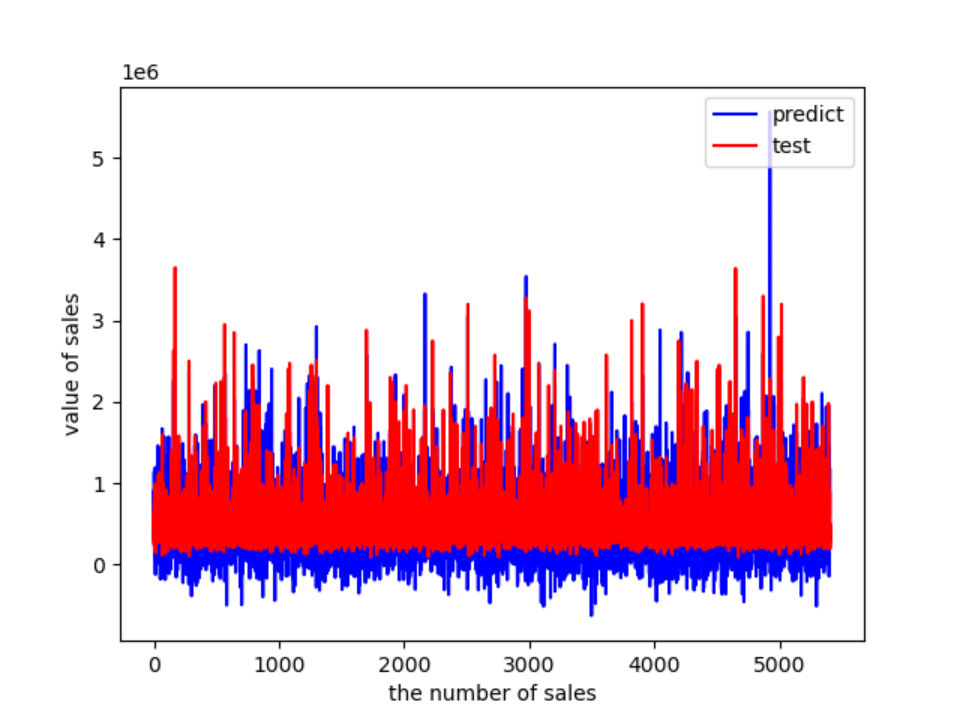

本文目标:理解什么是集成学习,明确Bagging算法的过程,熟悉随机森林算法的原理及其在Sklearn中的各参数定义和使用方法 代码…

机器学习 | 如何利用集成学习提高机器学习的性能?

目录

初识集成学习

Bagging与随机森林

Otto Group Product(实操)

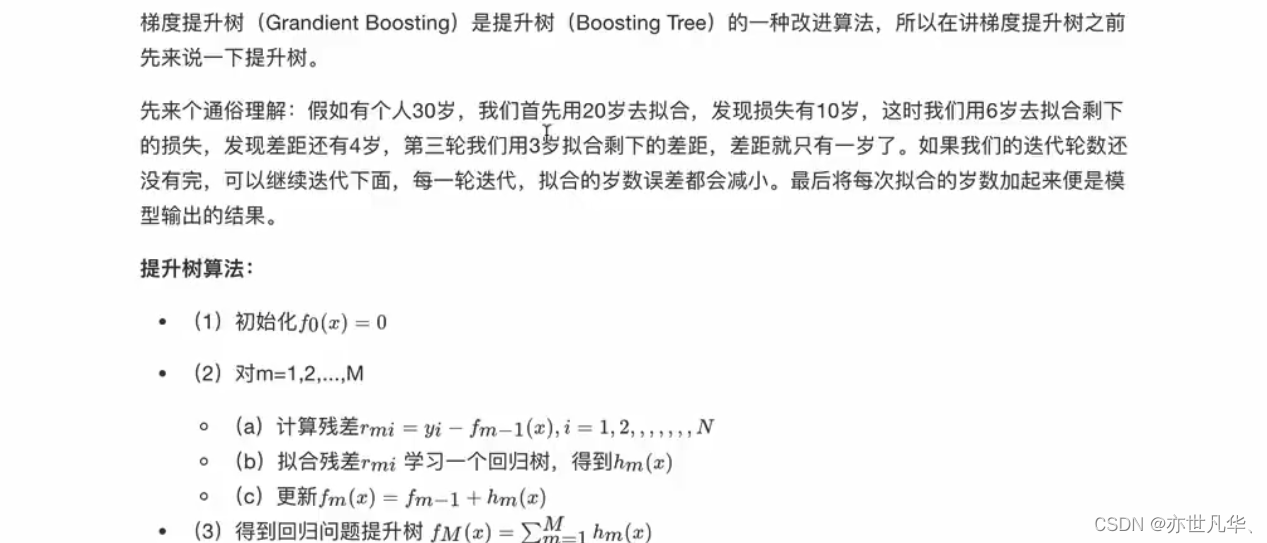

Boosting集成原理 初识集成学习

集成学习(Ensemble Learning)是一种通过组合多个基本模型来提高预测准确性和泛化能力的机器学习方法。它通过将多个模型的预测结果进行整合或投票来做…

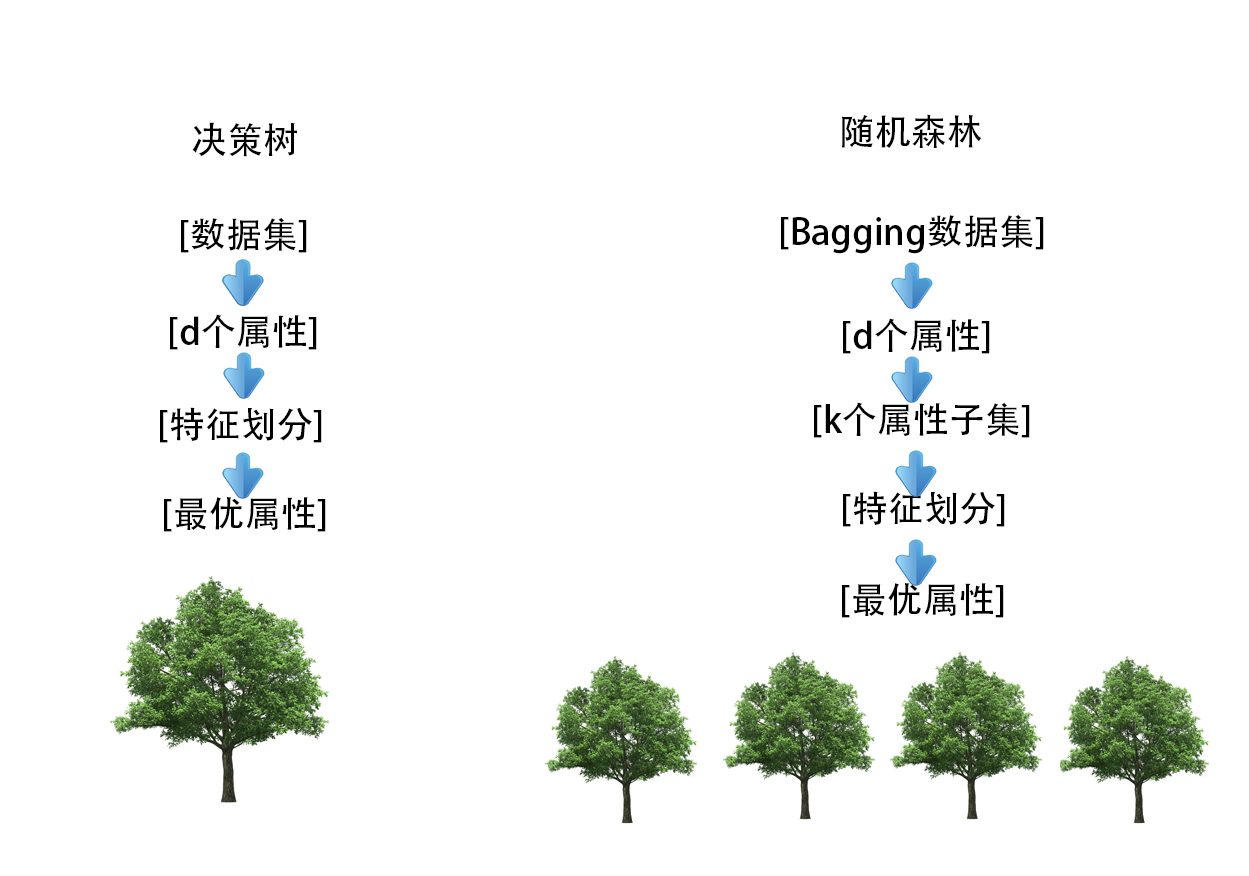

怎样通俗易懂理解Bagging和随机森林

大家好,我是翔宇!

今天我想和大家聊一聊什么是机器学习中的Bagging思想和随机森林。由于代码实现比较复杂,因此,我没有准备现在进行代码展示,可能后续会有,当然我这里说的代码实现不是指掉包使用ÿ…

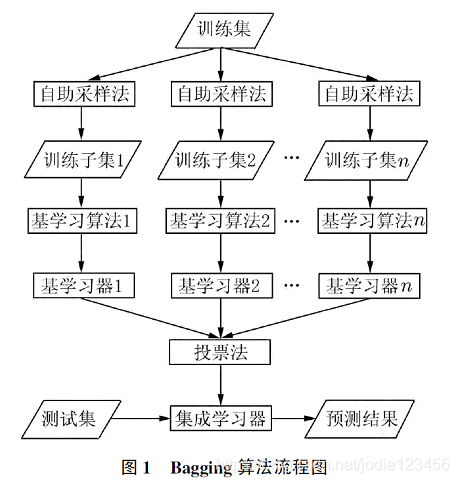

集成学习 | 集成学习思想:Bagging思想

目录 一. Bagging思想1. Bagging 算法2. 随机森林(Random Forest)算法 在正文开始之前,我们先来聊一聊什么是集成学习? 集成学习是一种算法思想:将若干个弱学习器分组之后,产生一个新的学习器 弱学习器指预测误差在50%以下的学习器…

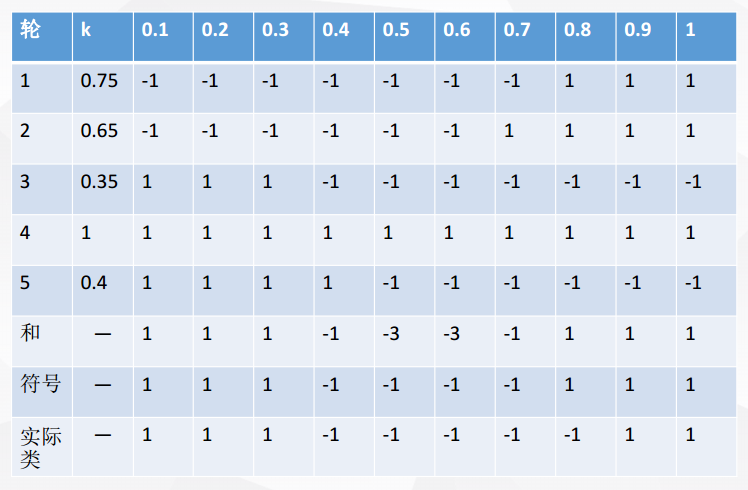

集成学习法之bagging方法和boosting方法

一、集成学习法(Ensemble Learning)

首先,让我们先来了解一下,什么是集成学习法。 ① 将多个分类方法聚集在一起,以提高分类的准确率。

(这些算法可以是不同的算法,也可以是相同的算法。&…

KAGGLE ENSEMBLING GUIDE(注脚)

About TrsKAGGLE ENSEMBLING GUIDECreating ensembles from submission filesVoting ensemblesError correcting codesA machine learning exampleA pinch of maths Number of votersCorrelation模型相关性Use for Kaggle Forest Cover Type predictionWeighing Use for Kaggle…

集成学习-随机森林原理与实现 西瓜书

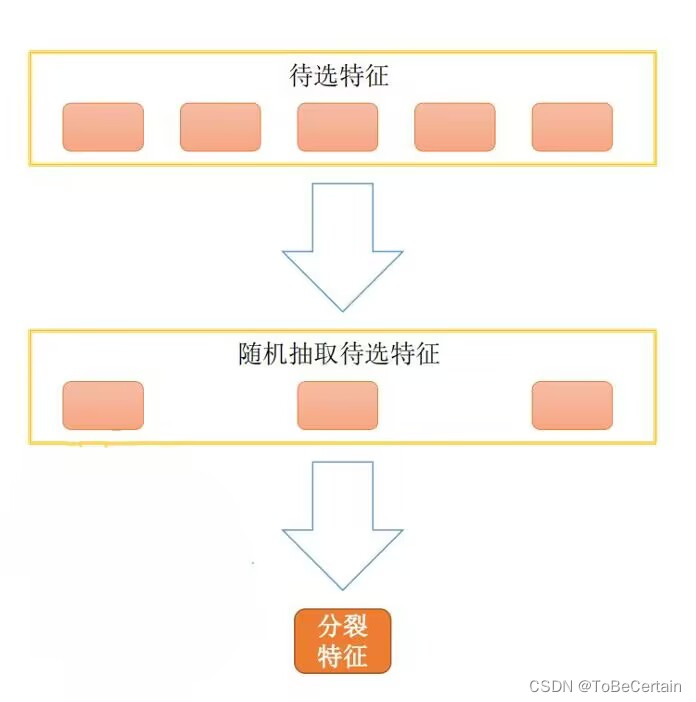

多样性增强 在讲随机森林之前,先讨论一下多样性增强.在集成学习中需要有效的生成多样性大的个体学习器,与构造单一学习器对比而言,一般是通过在学习过程中引入随机性,常见的做法是对数据样本,输入属性,输出…

机器学习实验报告-集成学习

目录

一、集成学习介绍

1.1集成学习的引入

1.2集成学习发展史

1.3集成学习的学习组织方式

1.3.1并联组织关系

1.3.2串联组织关系

1.4集成学习及其实现方法概述

二、集成学习实现方法

2.1Boosting

2.1.1基本过程

2.1.2注意点

2.2bagging

2.2.1基本过程

2.2.2注意点…

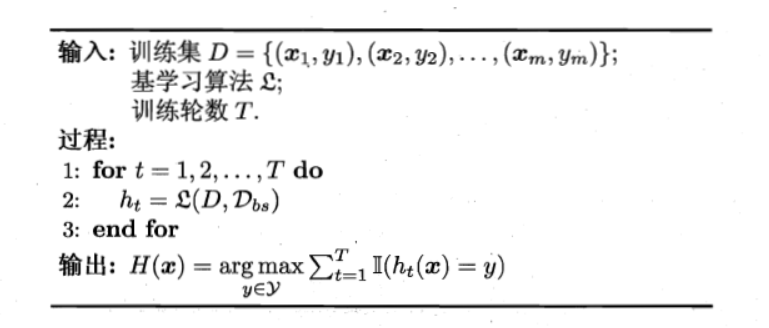

集成学习-Bagging原理与实现 西瓜书

Bagging简介

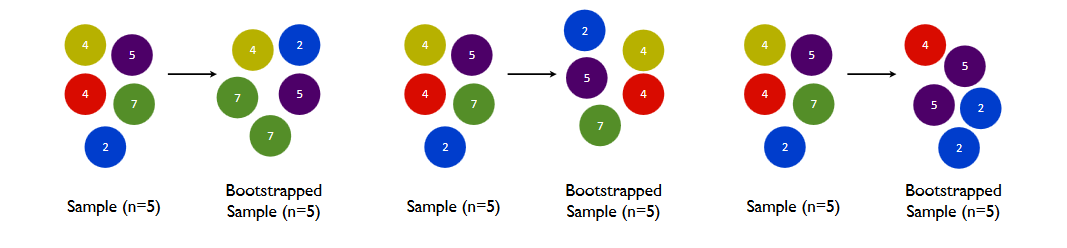

Bagging是并行式集成学习的最著名代表,名字是由Bootstrap AGGregatING缩写而来,看到Bootstrap我们就会联想到boostrap的随机模拟法和它对应的样本获取方式,它是基于自助采样法(Boostrap sampleing)&#…

葫芦书笔记----集成学习

集成学习

集成学习是一大类模型融合策略和方法的统称。

集成学习的种类

集成学习分哪几种?它们有何异同?

速记:Boosting(串行);Bagging(并行)

详细:

Boosting

Boo…

机器学习之Blending与Bagging(机器学习技法)

一个融合的故事

今天我的朋友向我荐股(这只股涨还是跌)我该怎么办,有以下的4种解决方法:

①我只接受我最信任的朋友的意见(Validation模型检验)。

②我让我的朋友们去投票然后选择票数最高的那一股。

③我让…

随机森林 {Keras 由浅入深}

随机森林

TensorFlowKerassklearn

python & mathematics 随机森林是集成学习中的一种方法。 随机森林采用的方法为bagging(样本不放回) from sklearn.ensemble import RandomForestClassifier可参考链接: https://www.cnblogs.com/zongf…

Sklearn-RandomForest随机森林参数及实例

本文转载至Sklearn-RandomForest随机森林参数及实例

在scikit-learn中,RandomForest的分类类是RandomForestClassifier,回归类是RandomForestRegressor,需要调参的参数包括两部分,第一部分是Bagging框架的参数,第二部…

集成学习-bagging

bagging集成学习中最为经典的算法之一。

Bagging算法的基本思想是:自助采样和投票表决

Bagging就是,有放回采样m个样本,这件事进行T(T一般是奇数)次,这样就得到了T个不相同的训练集,分别用于取…